Linux集群构建是大数据处理中不可或缺的一部分,它通过多台计算机的协同工作,提升数据处理效率和系统稳定性。选择合适的Linux发行版,如Ubuntu或CentOS,能够为后续的配置和管理提供便利。

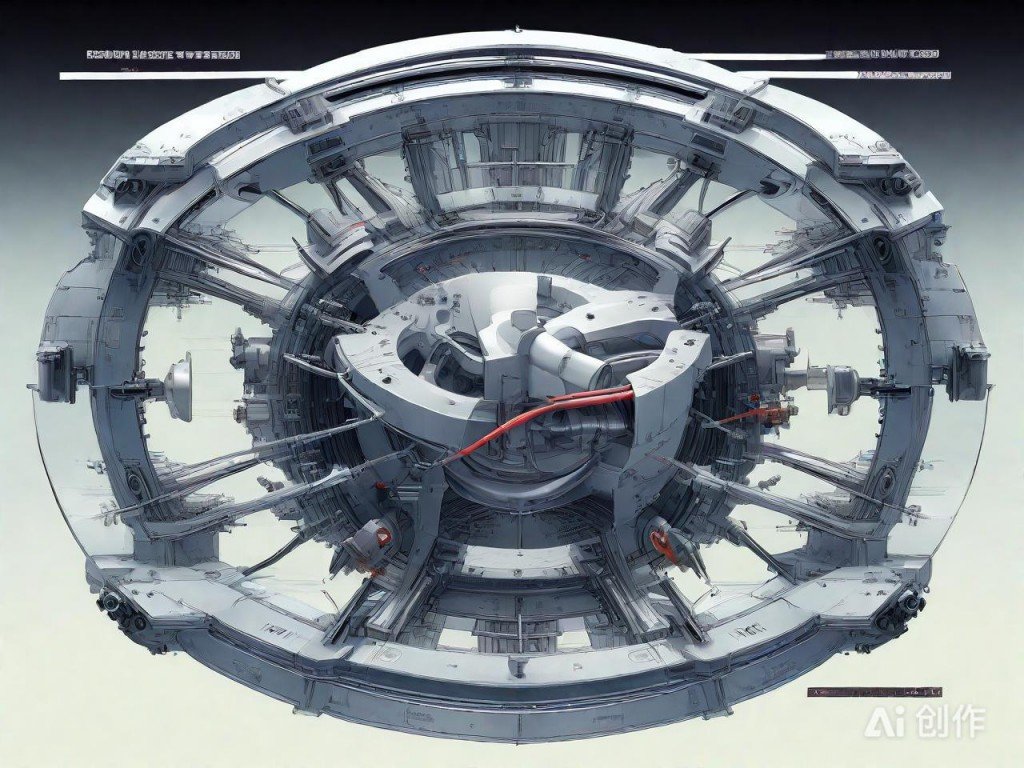

AI绘图结果,仅供参考

在构建集群时,网络配置是关键环节。确保所有节点之间的通信畅通,设置静态IP地址,并配置SSH免密登录,可以显著提高集群的运行效率和管理便捷性。

软件工具的选择同样重要。Hadoop、Spark等大数据框架在Linux环境下表现优异,合理安装和配置这些工具,能够充分发挥集群的计算能力。同时,监控工具如Nagios或Prometheus有助于实时掌握集群状态。

数据存储优化也是提升性能的重要方面。采用分布式文件系统如HDFS,可以有效管理大规模数据,并通过合理的副本策略保障数据安全。•调整系统内核参数和文件系统设置,也能进一步提升I/O性能。

•持续的维护和优化是保证集群长期稳定运行的基础。定期检查日志、更新软件版本,并根据实际负载调整资源配置,能够确保集群始终处于最佳状态。